Comment achèterons-nous demain? J’ai eu le plaisir d’assister à la Fashion Tech Week de San Francisco. On est dans un tout autre monde que NY, Milan et Paris. Ici on parle data et tech, au service du client roi. Quelques start-up émergent déjà sur l’intelligence artificielle et la «computer vision».

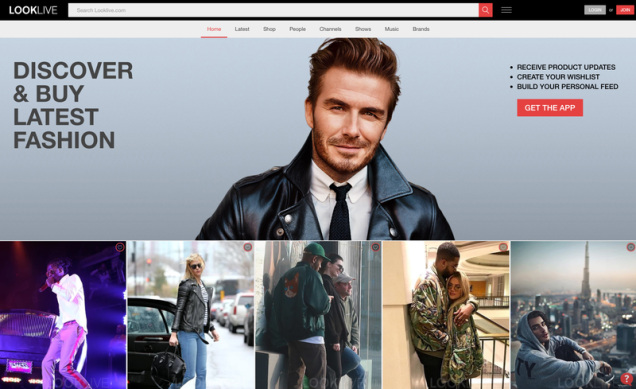

Vous adorez la petite veste cintrée de votre voisine au restaurant où vous avez pris une salade entre deux réunions, et vous vous voyez bien la porter à la réunion de famille du Nouvel An? Go Find AI vous permet de trouver un vêtement similaire sur la base d’une photo, des designers aux marques plus accessibles en prix. Votre filleul est un fan de Justin Bieber (eh oui!), Looklive vous dira ce que sa célébrité favorite porte et où l’acheter. Ils sont passés par Y Combinator, après avoir créé leur start up à Atlanta. Vous voulez essayer des petites robes pour acheter votre tenue du nouvel an, Fit 3D vous permet d’avoir vos mensurations exactes et d’acheter la bonne taille et la marque qui vous correspond. Enfin, si vous déménagez en janvier, Make-trays.com vous permet d’avoir vos «mood boards» pour inspirer votre futur intérieur, et c’est Om Malik qui parle le mieux de @hey_judes (Jude Sue). Elle vient de New York, et allie son cursus de designer et son œil, à la puissance du machine learning.

Nouvelle génération

Les passerelles côte Est/Europe et Californie se font à juste titre: il faut non seulement maîtriser la technologie, les algorithmes et la «computer vision», mais aussi savoir signer les bons partenariats avec les marques, distributeurs et médias, produire et animer le bon contenu, créer une communauté adepte du nouveau service, contribuant au bouche-à-oreille. Se faire connaître, et générer des revenus.

Ce qui est certain, c’est que la génération Z commence à fonder des start-up, et que sa manière d’envisager l’expérience shopping n’a rien à voir avec ce qui existe. Nos comportements sont susceptibles d’évoluer en les prenant en modèle.

Revenons maintenant à quelques notions tech, car celle-ci est partie intégrante du succès. J’ai ainsi assisté à un «call» d’une start-up ambitieuse en shopping mode avec l'un des business angels respectés du fameux Band of Angels: l’investisseur a finalement renoncé au deal malgré un chiffre d’affaires en croissance pour la start-up, car il ne comprenait pas leur barrière à l’entrée et surtout leur différenciation technologique.

5 millions d'années d'histoire

Jitendra Malik, professeur à l’université de Berkeley (PhD en computer sciences de Stanford) est intervenu dans une conférence sur la «computer vision» organisée par The Hive (incubateur en big data) dans les bureaux de SAP à Palo Alto. Son public expert, âgé de trente ans en moyenne, après avoir partagé un verre et des toasts au fromage, était très concentré sur les enjeux: «Deep visual understanding from deep learning». Ou comment acquérir, analyser et comprendre des images digitales, et extraire de données non structurées une information qui permette de prendre des décisions.

Quand les ordinateurs seront-ils aussi intelligents que l’humain ? nous demande-t-il. «Deep learning» revient à parler de neuro-sciences et du réseau neuronal, stimulés par l’expérience pour un humain. Après avoir rappelé les dates-clés, les avancées réelles des deux dernières années et la courbe exponentielle de progrès sur l’AI, son sujet dans de nombreuses publications, Jitendra Malik est revenu sur l’évolution de l’homme depuis 5 millions d’années. Tout commence par la vision et le mouvement, avant même de manipuler des objets et d’apprendre le langage. «Si un être n’a pas besoin de bouger, il n’a besoin ni d’yeux, ni de cerveau», affirme t-il.

L'enfance de l'art

L’apprentissage des enfants suit le même chemin que celui de l’humanité, a-t-il souligné en montrant un charmant bébé sur son tapis de jeu coloré, jouant avec des formes de couleurs différentes. Les succès en intelligence artificielle ont eu lieu dans le même ordre: les voitures connectées, avec des caméras aussi puissantes et précises que l’œil humain sont la première concrétisation des progrès faits, et permettent d’associer vision et déplacement.

A son tour, la détection d’objets sur une photo est en train de faire des avancées significatives, grâce à vous, oui, avec le volume énorme de photos existant maintenant sur le web et les réseaux sociaux. Les «3 R» de la vision des ordinateurs sont la reconnaissance, la reconstruction et la réorganisation. La perception globale, ou «embodied cognition vision», s’appuie sur le contrôle des mouvements (planing) et le langage (raisonnement sémantique). La limite actuelle est la faible intelligence sociale des ordinateurs. Il faudrait comprendre l’état interne des humains quand ils interagissent ensemble et avec le monde extérieur.

Dans sa conclusion, Jitendra Malik pense que l’apprentissage des ordinateurs pourrait s’inspirer des leçons tirées en observant les enfants et leur capacité à agir dans des situations nouvelles. L’AI est sur une courbe exponentielle, et les trente prochaines années ne ressembleront pas au trente dernières. Préparons-nous aux applications pratiques qui vont être nombreuses et révolutionner le business, créer de nouvelles manières de faire son shopping, réinventer l’expérience d’achat et de consommation. Exciting! Très belles fêtes à tous!